香港城市大學

研发AI、机器学习技术 看图说句 造福人类

教育资讯

香港城市大学

电脑科学系

人工智能

ai

Deep Learning

陈万师博士

一张图像胜过千言万语,当中可以包含许多信息,现今科技有否解读图中信息的能力呢?香港城市大学电脑科学系副教授陈万师与学生研究以人工智能「看图说话」,让电脑分析图片,总结出文字描述,不但能帮助视障人士阅读图片,也提升利用句子搜寻所需照片的精准度。

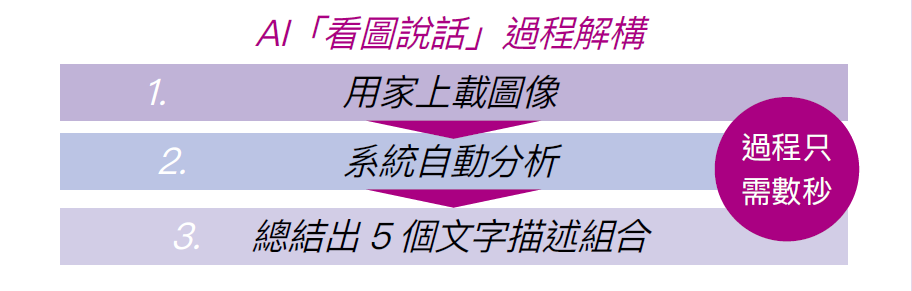

只需数秒 从照片解读出文字描述

陈万师博士与学生花了约半年时间研究出操作方法简单的程式,技术建基于深度学习(Deep Learning),以人工神经网路为架构,对资料进行表征学习的算法。

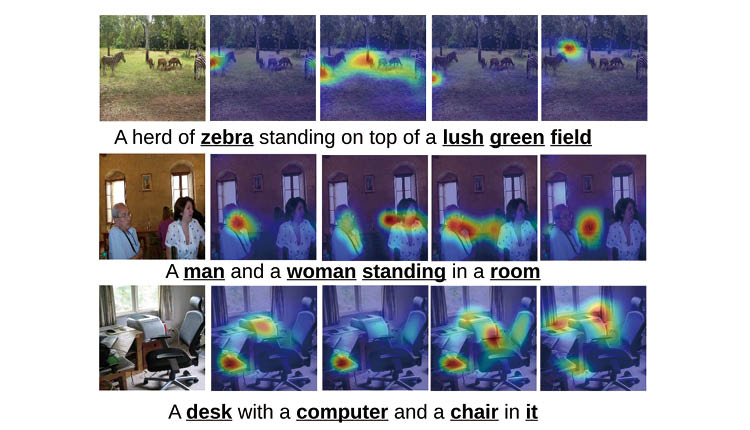

陈博士指系统模仿人类看图模式,先让电脑学会像眼睛一样阅读图像的各部分,抽取当中概念,然后处理语言,创建句子,再连结视觉和语言部分,组成完整的文字描述。「例如系统在照片中分辨到三个重点概念,蓝色、车和街道,然后得出『一辆蓝色的车停泊在街道』的描述。」

陈万师博士研发的人工智能,分析图片后会产出文字描述,并朝更精准、更多样性等方向进阶研究。

辅助阅读图像 造福视障人士

视障人士缺乏接收图像的媒介,程式令他们可以利用电脑分析取得描述,以不同方式感知世界。陈博士分享,程式不但便利视障人士,亦有利于搜寻图像。「以往如果我们想寻找图像,会在搜寻器输入关键字,但这些字词只是概念,准确度不及句子高。」透过AI 技术,我们可以用完整句子描述所需照片,例如输入「一只老虎在大树下休息」,就可以精准地于海量的照片中找到包含所需元素的图像。

增加描述多样性 更贴合人类所需

目前系统虽然简单易用,但仍有改善空间。陈万师博士举例,如果向5 个人展示同一张图片,基于每人知识水平及见解不同,所以会作出不一样的描述。「我给你一张篮球员比赛中的照片,如果你对篮球不熟悉,可能会形容为球员在进行球赛,但如果你熟悉篮球球星,就会知道其中一人是米高佐敦。」因此,他与学生希望优化系统,使其变得更人性化,增加图片描述多样性,贴合不同用家需要。

提及未来发展,陈万师博士指利用AI 把图像转化成完整文句的技术,现时主要应用在教育范畴,将来希望能发展成完整的搜索引擎,推至普及层面。

4205fef5759f42e7cfe5d4337c6cdc8f75.jpg)

20906bc557ec73bfe8e86e56776572714.jpg)